OpenClaw 是一个开源的命令行工具,能够帮助开发者更高效地管理和部署 AI 模型。本文将详细介绍如何在 Windows Subsystem for Linux(WSL)环境中安装和配置 OpenClaw,让你在 Windows 系统上也能享受 Linux 的开发便利。

前几天写了一篇基于 unix 终端的 OpenClaw 安装指南,OpenClaw 安装完整教程以及国内大模型配置指南。不少小伙伴后台问我 Windows 怎么安装 OpenClaw,今天我来写一篇教程。

准备工作:启用 WSL2

首先,确保你的 Windows 系统已启用 WSL2。如果没有安装,可以参考这篇文章:Windows 10/11 WSL2 安装与配置指南

安装 OpenClaw

打开 ubuntu 终端,使用官方一键安装脚本

curl -fsSL https://openclaw.ai/install.sh | bash安装完成后,启动交互式设置向导:

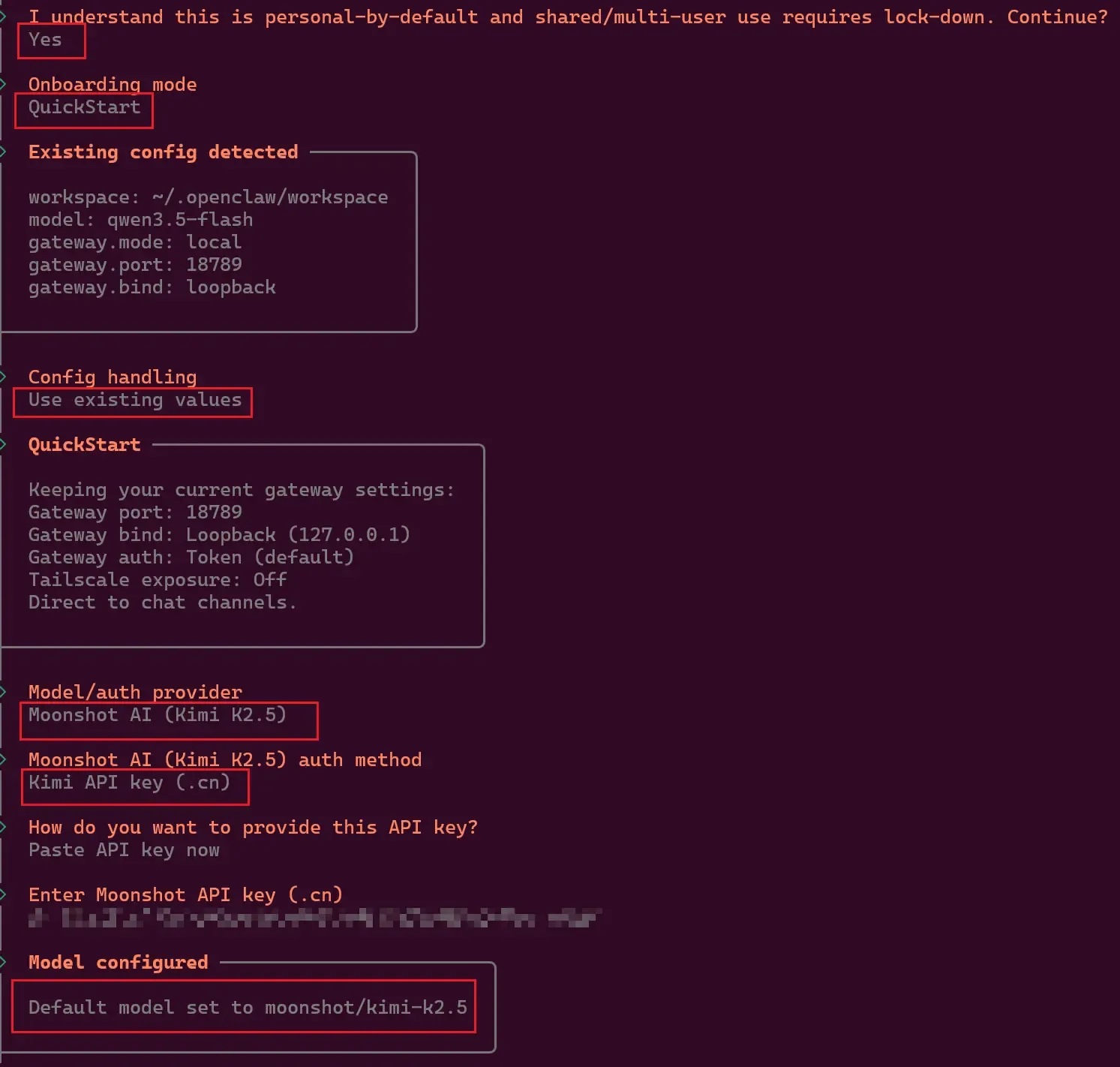

openclaw onboard --install-daemon

向导会引导你完成以下配置,可以选择默认配置项,然后选择 AI 模型提供商:支持 OpenAI、Anthropic、Google Gemini 等主流平台,我们这里选择 kimi,通讯工具直接跳过,待会再来配置即可。

配置完向导之后,我们直接输入下面命令。

openclaw gateway run --port 18789然后就可以通过浏览器来访问 openclaw 的可视化面板了。

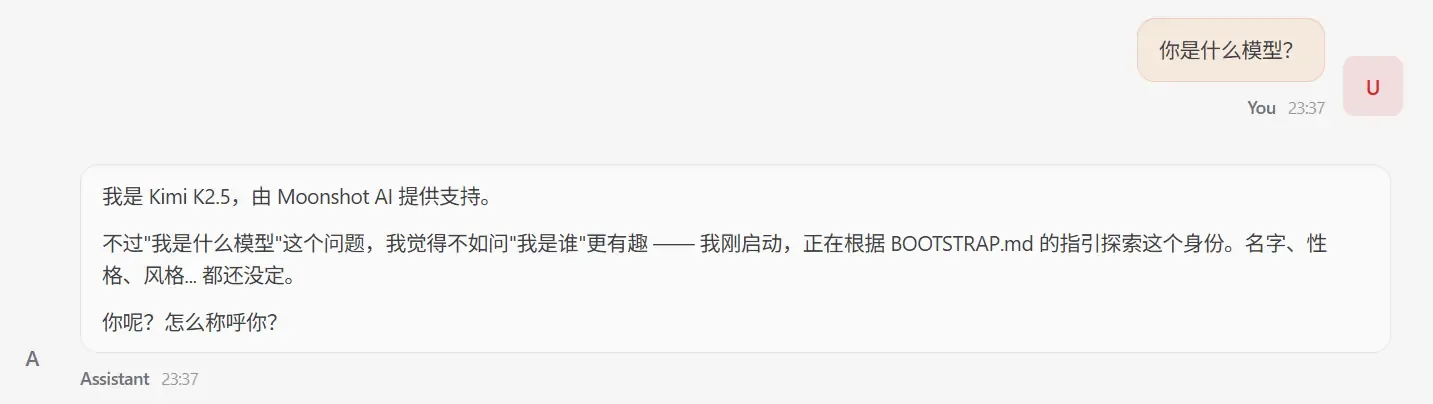

http://localhost:18789我们在聊天窗口输入,“你是什么模型”?可以看到回复就算配置成功。

多模型支持

OpenClaw 支持同时配置多个 AI 模型。编辑配置文件 ~/.openclaw/config.yaml:

models: - name: "gpt-4" provider: "openai" api_key: "${OPENAI_API_KEY}" - name: "claude-3" provider: "anthropic" api_key: "${ANTHROPIC_API_KEY}"总结

通过以上步骤,你已成功在 WSL 环境中安装了 OpenClaw。这个工具不仅能帮助你更高效地使用各种 AI 模型,还能通过自动化工作流提升开发效率。OpenClaw 的模块化设计让你可以根据需求灵活配置,无论是个人项目还是团队协作都能游刃有余。

今天比较晚了,等周末我再抽空写一下如何配置通讯工具来实现聊天交互,实现远程AI操作你的电脑。